Для кодирования 1 секунды звука используется число битов, которое называется битрейтом. Битрейт определяет количество битов, которое передается или записывается за единицу времени и отвечает за качество звука. Чем выше битрейт, тем лучше качество звука, но и больше размер файлов. В музыкальных файловых форматах часто используется битрейт 128, 192 или 320 kbps (килобит в секунду), что означает количество передаваемых или записываемых битов в секунду.

Количество каналов. Формула объема звука

Количество каналов в звуке определяет, на сколько отдельных дорожек разбивается звуковой сигнал. Это позволяет создавать эффект пространственного звучания и передавать звук в стерео или многоканальном формате.

Для определения формулы объема звука необходимо учитывать количество битов, битовая глубина, частоту дискретизации и количество каналов.

Количество каналов

Количество каналов в звуке обозначается числом, которое указывает на количество дорожек, по которым передается звуковой сигнал. Наиболее распространенными являются моно (одноканальный) и стерео (двухканальный) звук.

Формула объема звука

Для расчета объема звука используется следующая формула:

| Параметр | Обозначение |

|---|---|

| Битовая глубина | B |

| Частота дискретизации | F |

| Количество каналов | C |

| Продолжительность звука | T |

Формула для расчета объема звука:

Объем звука = B * F * C * T

Где:

- B – битовая глубина, определяет количество битов, используемых для кодирования одного сэмпла звукового сигнала;

- F – частота дискретизации, указывает на количество сэмплов, записываемых в секунду;

- C – количество каналов, определяет на сколько дорожек разбивается звуковой сигнал;

- T – продолжительность звука в секундах.

С помощью данной формулы можно рассчитать объем звука в байтах или битах в зависимости от требуемой точности и качества звучания. Это позволяет оптимизировать объем звуковых файлов и выбрать наиболее подходящие параметры для передачи и воспроизведения звука.

Частота дискретизации звука

Важность частоты дискретизации

Частота дискретизации играет ключевую роль при оцифровке звука, поскольку влияет на точность воспроизведения и качество звуковой записи. Чем выше частота дискретизации, тем больше информации запоминается за единицу времени, что позволяет более точно и достоверно передавать звуковые сигналы.

- Концепция частоты дискретизации была впервые представлена Колом Хезертоуном в 1950-х годах.

- Согласно теореме Котельникова (или теореме Найквиста-Шеннона), частота дискретизации должна быть минимум в два раза выше максимальной частоты входного аналогового сигнала, чтобы обеспечить его правильное воспроизведение и сохранить информацию о нем.

- Различные стандарты работы с аудио (например, CD-качество = 44.1 кГц, профессиональные аудиозаписи = 96 кГц и выше) устанавливают различные частоты дискретизации для наилучшего качества звуковой записи.

Сравнение частот дискретизации

| Частота дискретизации | Описание | Примеры использования |

|---|---|---|

| 8 кГц | Низкая частота дискретизации | Телефонные разговоры, звуковые коммуникации в интернете |

| 44.1 кГц | Стандартная частота дискретизации для аудио CD | Массовое производство и распространение музыкальных записей |

| 96 кГц и выше | Высокие частоты дискретизации | Профессиональные аудиозаписи, студийная работа, высококачественное аудио |

Частота дискретизации звука влияет на качество оцифровки и воспроизведения звуковой информации. Высокая частота дискретизации позволяет сохранить больше деталей и информации о звуковом сигнале. Различные стандарты и использования требуют разных частот дискретизации для достижения наилучшего качества звучания. Важно выбирать частоту дискретизации, соответствующую конкретным потребностям и ожиданиям пользователей.

Основные методы кодирования звуковой информации

1. Пульс-кодовая модуляция (PCM)

PCM – это метод кодирования звуковой информации, основанный на ее сэмплировании и квантовании. Звуковой сигнал разбивается на маленькие участки, называемые сэмплами, которые затем измеряются и представляются в цифровом виде. Количество битов, используемых для представления каждого сэмпла, определяет разрешение и динамический диапазон звука.

2. Адаптивное дифференциальное кодирование (ADPCM)

ADPCM – это метод кодирования звуковой информации, который представляет сигнал в виде разностей между последовательными сэмплами. Вместо сохранения каждого отдельного сэмпла, ADPCM сохраняет только разности между ними. Это позволяет сократить объем хранения и передачи звуковой информации без существенного снижения ее качества.

3. Линейное предсказательное кодирование (LPC)

LPC – это метод кодирования звуковой информации, основанный на моделировании и предсказании будущих значений звукового сигнала. LPC анализирует звуковой сигнал и находит его спектральные характеристики, которые затем используются для создания модели, предсказывающей будущие значения сигнала. Разница между предсказанным и фактическим значением кодируется и передается в цифровом формате.

4. Формат сжатия звука с потерями (MP3)

MP3 – это стандартный формат сжатия звука, который использует алгоритмы с потерями для уменьшения размера звукового файла. Алгоритмы MP3 исключают некоторые данные, которые, с точки зрения слуха, несущественны или не заметны. В результате получается компактный файл с высоким качеством звука, который может быть легко передан и воспроизведен на различных устройствах.

| Метод | Описание | Преимущества | Недостатки |

|---|---|---|---|

| PCM | Сэмплирование и квантование звукового сигнала | Высокое качество звука | Большой объем хранения |

| ADPCM | Кодирование разностей между сэмплами | Снижение объема хранения и передачи | Небольшая потеря качества звука |

| LPC | Предсказание будущих значений звукового сигнала | Эффективное сжатие звука | Сложность алгоритма |

| MP3 | Сжатие звукового файла с потерями | Высокий уровень сжатия | Некоторая потеря качества звука |

Звуковая информация может быть закодирована с использованием различных методов, включая пульс-кодовую модуляцию (PCM), адаптивное дифференциальное кодирование (ADPCM), линейное предсказательное кодирование (LPC) и формат сжатия звука с потерями (MP3). Каждый из этих методов имеет свои преимущества и недостатки, и выбор определенного метода зависит от конкретной задачи и требований к качеству звука. Например, PCM обеспечивает высокое качество звука, но требует большого объема хранения, а MP3 обеспечивает высокий уровень сжатия, но с некоторой потерей качества звука. Выбор метода кодирования звуковой информации должен быть основан на балансе между качеством звука и объемом хранения или передачи.

Примеры форматов звуковых файлов

Звуковые файлы могут быть сохранены в различных форматах, каждый из которых имеет свои особенности и применение. Разберём несколько примеров популярных форматов звуковых файлов.

1. WAV (Waveform Audio File Format)

WAV – один из наиболее распространённых и универсальных форматов для хранения звуковых данных. Он позволяет сохранить звук без потери качества, так как использует несжатое аудио. Файлы в формате WAV могут содержать как стерео, так и моно записи. Качество звука в формате WAV обычно выше, чем в других форматах, но при этом файлы занимают больше места.

2. MP3 (MPEG Audio Layer III)

MP3 – наиболее популярный формат для сжатия аудио. Он использует алгоритмы сжатия, которые позволяют значительно уменьшить размер файла без существенной потери качества звука. Файлы в формате MP3 легко воспроизводятся на различных устройствах и имеют малый размер, что делает их идеальным выбором для потокового воспроизведения музыки и загрузки файлов из сети.

3. FLAC (Free Lossless Audio Codec)

FLAC – формат, который позволяет сжимать аудио без потери качества. Он поддерживает персонализацию параметров сжатия и обеспечивает воспроизведение аудио высокого качества. Файлы в формате FLAC обычно занимают больше места, чем файлы в формате MP3, но сохраняют оригинальное качество звука.

4. AAC (Advanced Audio Coding)

AAC – формат, разработанный для замены MP3. Он обеспечивает более эффективное сжатие и лучшее качество звука при том же размере файла. Файлы в формате AAC имеют расширение .m4a и часто используются для хранения музыки в iTunes и на устройствах Apple.

5. OGG (Ogg Vorbis)

OGG – свободный формат сжатия звука, который позволяет достичь хорошее качество при меньшем размере файла по сравнению с MP3. Он широко используется в интернете для воспроизведения потокового аудио.

6. AIFF (Audio Interchange File Format)

AIFF – формат, разработанный Apple для хранения несжатых аудиоданных. Он обеспечивает высокое качество звука, но занимает больше места, чем сжатые форматы. Файлы в формате AIFF поддерживаются многими программами и устройствами.

Дискретизация по времени и уровни громкости

Дискретизация по времени

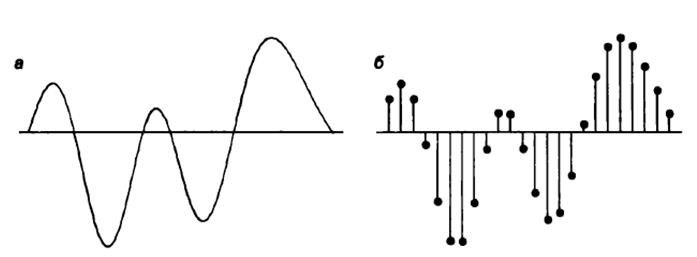

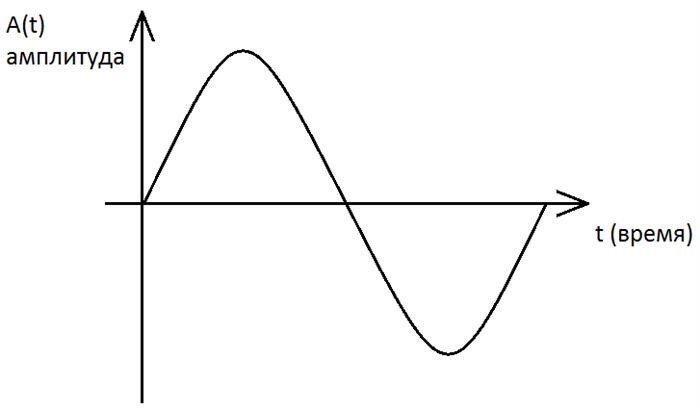

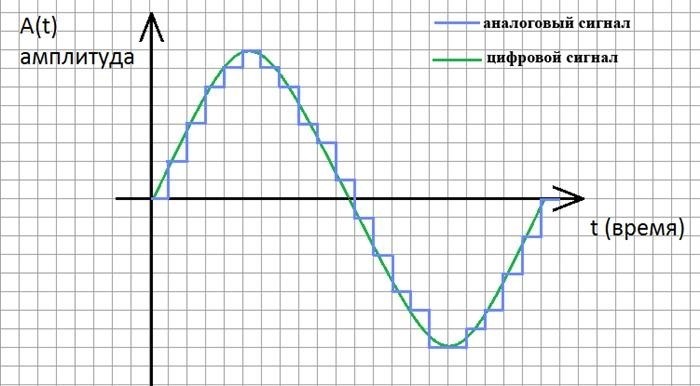

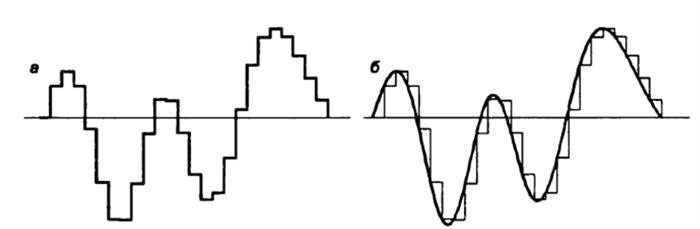

Дискретизация по времени – процесс разбиения аналогового сигнала звука на равные промежутки времени и определение значения сигнала в каждом из этих моментов. Чем больше число разбиений (то есть частота дискретизации), тем более точным будет цифровое представление звука.

Для определения значения сигнала в каждый момент времени, используется аналогово-цифровой преобразователь (АЦП). АЦП измеряет амплитуду сигнала в заданных моментах времени и присваивает ему определенное число, которое и представляет уровень громкости (амплитуду) в цифровой форме.

Чем выше частота дискретизации, тем точнее будет формироваться цифровое представление сигнала и, соответственно, выше будет качество звука, но при этом увеличивается объем данных.

Уровни громкости

Уровни громкости определяются числом битов, используемых для кодирования амплитуды сигнала в каждый момент времени. Чем больше битов используется для кодирования, тем большую амплитуду и, следовательно, громкость можно передать. Величина числа битов называется разрешающей способностью.

Таблица ниже показывает количество битов и разрешающую способность для различных уровней громкости:

| Биты | Разрешающая способность |

|---|---|

| 8 | 256 уровней громкости |

| 16 | 65 536 уровней громкости |

| 24 | 16 777 216 уровней громкости |

Дискретизация по времени и уровни громкости являются важными аспектами преобразования аналогового сигнала звука в цифровой формат. Частота дискретизации и разрешающая способность определяют качество и точность представления звука в цифровом виде. Выбор оптимальных значений этих параметров позволяет достичь высокого качества звука при минимальном объеме данных.

Сколько бит информации необходимо для кодирования 13 битов?

В цифровых системах информация кодируется в виде последовательности битов. Каждый бит представляет отдельную единицу информации. Таким образом, 13 битов позволяют закодировать 13 отдельных единиц информации.

Примеры использования 13 битов:

- Кодирование 13 различных символов или символьных комбинаций, таких как буквы алфавита, цифры или специальные символы.

- Передача 13-битовых чисел в цифровых системах.

- Хранение информации, состоящей из 13 битов, в компьютерных системах или других устройствах хранения данных.

| Количество битов | Назначение |

|---|---|

| 13 | Кодирование 13 единиц информации |

Таким образом, для кодирования 13 битов информации требуется использовать 13 битов.

Информационный объем звукового файла

Информационный объем звукового файла определяется количеством битов, используемых для кодирования звука. Каждый бит кодирует определенное количество информации, и чем больше битов используется, тем более точно и детально звук воспроизводится.

Наиболее распространенными форматами аудиофайлов являются WAV и MP3. Формат WAV использует без потерь сжатия данные и обычно имеет более высокую точность, но занимает больше места на диске. Формат MP3, с другой стороны, использует потери сжатия и имеет более низкое качество звука, но занимает меньше места.

Информационный объем звуковых файлов может быть оценен с помощью следующих факторов:

- Битовая глубина: это количество битов, используемых для представления каждого отдельного звукового сэмпла. Чем выше битовая глубина, тем более точно воспроизводится звук и тем больше информации необходимо для его кодирования.

- Частота дискретизации: это количество сэмплов, которые берутся в секунду для записи звука. Чем выше частота дискретизации, тем более детально воспроизводится звук, но тем больше информации требуется для его записи.

- Количество каналов: звук может быть записан в одном или в нескольких каналах. Обычно используется стерео (два канала) или моно (один канал). Чем больше каналов, тем больше информации требуется для записи звука.

Таким образом, итоговый информационный объем звукового файла зависит от его формата, битовой глубины, частоты дискретизации и количества каналов. Выбор оптимальных параметров для записи и кодирования звука позволяет достичь баланса между качеством звука и объемом файла. Как правило, чем выше качество звука требуется, тем больше информации необходимо для его записи и кодирования.